Рубрика: Выступления

Мои выступления и доклады на различных конференциях

Генерация данных для квантования нейронных сетей: Data-Free Quantization

В докладе обсудим современные подходы к Data-Free Quantization и как по самой нейронной сети получить данные того же домена.

Как действовать изо дня в день: строим мотивацию и привычки

В докладе рассмотрим механизмы работающей мотивации и получим конкретные шаги построения полезных привычек.

Квантование нейронных сетей: методы Quantization Aware Training

Рассмотрим, что такое квантование нейронных сетей. Обсудим, как оно помогает ускорять модели и позволяет запускать их не в облаках, а на конечных устройствах.

Под капотом у ChatGPT

Языковые модели проделали большой путь: от классификаторов текстов к универсальным переводчикам, а теперь и к персональному ассистенту. На докладе я расскажу, как работают современные языковые модели и как их обучают, чтобы вы смогли лучше понимать их возможности и перспективы развития

Обзор современных методов Contrastive learning

Несмотря на свою достаточно долгую историю, методы Contrastive Learning продолжают регулярно появляться в передовых работах последних лет и быть гостями на таких конференциях как CVPR, NeurIPS и многих других. Чтобы лучше разобраться в таких мощных сетях как CoCa (2022), CLIP (2021) и SimCLR (2020), нам предстоит сделать глубокое погружение в методы Contrastive Learning и увидеть, насколько гибкими и полезными они могут быть.

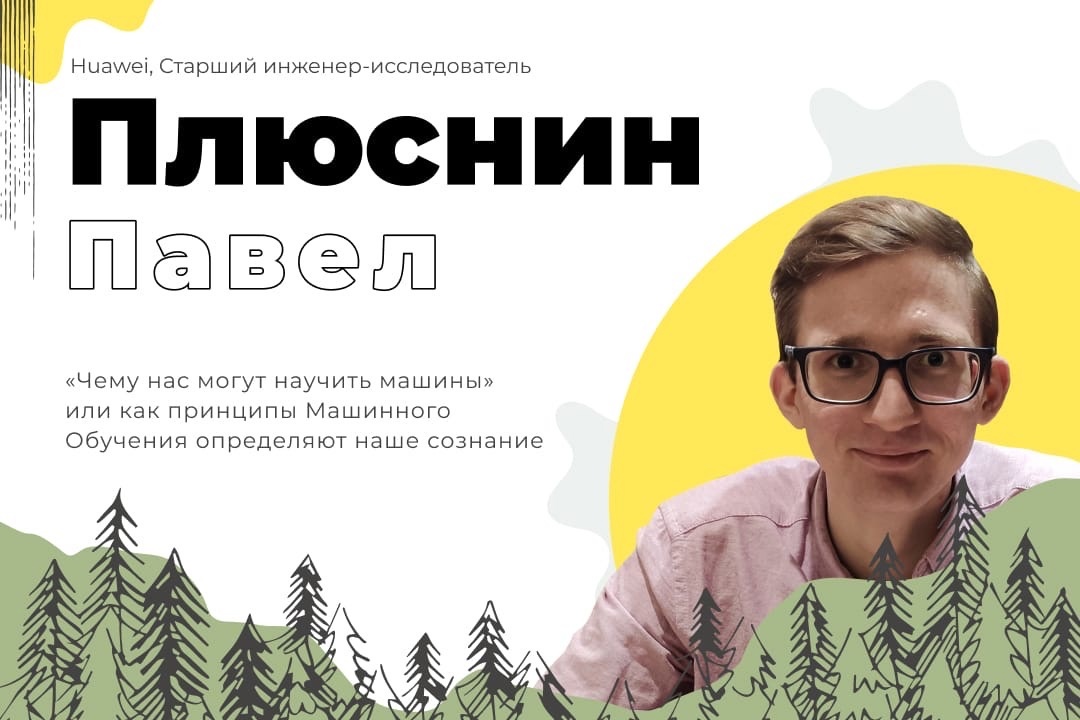

«Чему нас могут научить машины» или как принципы Машинного Обучения определяют наше сознание

Годами занимаясь Машинным Обучением, начинаешь замечать похожие механизмы в нашей повседневности. Раньше исследователи подсматривали у природы и переносили ее идеи в Анализ Данных, сейчас же я хочу поступить наоборот и поразмышлять, как основные концепции Машинного Обучения встроены в нашу психологию и реальность

Проблема балансирования тем в тематическом моделировании

Тематическое моделирование основано на принципе правдоподобия, который максимально задействует все свои параметры-темы, что приводит к их выравниванию, в результате чего крупные темы дробятся, а мелкие — объединяются в коллекциях с несбалансированными темами.

В данном посте показана описана проблема несбалансированности тем и предложен итеративный алгоритм для ее решения.